Por: Jussara Rowland

Ao longo do último ano, assistimos a um aumento significativo nas discussões sobre o uso da Inteligência Artificial (IA) na academia e os seus potenciais impactos. Este debate, impulsionado pelo lançamento público do ChatGPT em novembro de 2022, centrou-se inicialmente na criação de texto sintético por parte dos novos grandes modelos de linguagem, nos riscos de plágio e nas implicações destas tecnologias para as práticas de avaliação nas universidades. A discussão, entretanto, tem-se vindo a expandir, abrangendo outras questões relacionadas com as diversas implicações éticas, práticas e ambientais da adoção da IA no ensino superior.

Simultaneamente, testemunhámos a expansão da IA na academia em diferentes frentes que vão além do ChatGPT. As funcionalidades da IA, como transcrições automáticas, texto preditivo, ferramentas de anotação interativas, sínteses de artigos e reuniões, chatbots para pesquisas, e análises qualitativas e quantitativas com recurso à IA tornaram-se realidades na nossa vida académica e na dos estudantes que ensinamos. Funcionalidades que eram ainda relativamente incipientes durante os meses em que estivemos online durante a pandemia são agora parte integral das ferramentas que utilizamos nas nossas práticas de investigação quotidiana, quer queiramos quer não.

Diante deste cenário em que a crescente co-produção de conhecimento com algoritmos parece ser uma realidade cada vez mais incontornável, levantam-se algumas questões: que competências devemos desenvolver para lidar com esta nova realidade? Que tipo de reflexão é necessária para abordar os desafios que estas tecnologias apresentam para a investigação nas ciências sociais?

Ferramentas Digitais e Processo de Investigação

Os meus questionamentos em relação a este tema surgem no seguimento de uma aula que leciono há vários anos no âmbito do Programa de Doutoramento Inter-Universitário em Sociologia (OpenSoc) sobre ferramentas digitais no processo de investigação. Esta aula começou por se focar no uso de ferramentas de gestão bibliográfica, mas expandiu-se rapidamente para integrar uma reflexão mais ampla sobre o papel das ferramentas digitais na investigação e a necessidade de pensar de forma mais refletida sobre a sua integração num ‘academic workflow’ onde práticas analógicas e digitais se interligam e articulam.

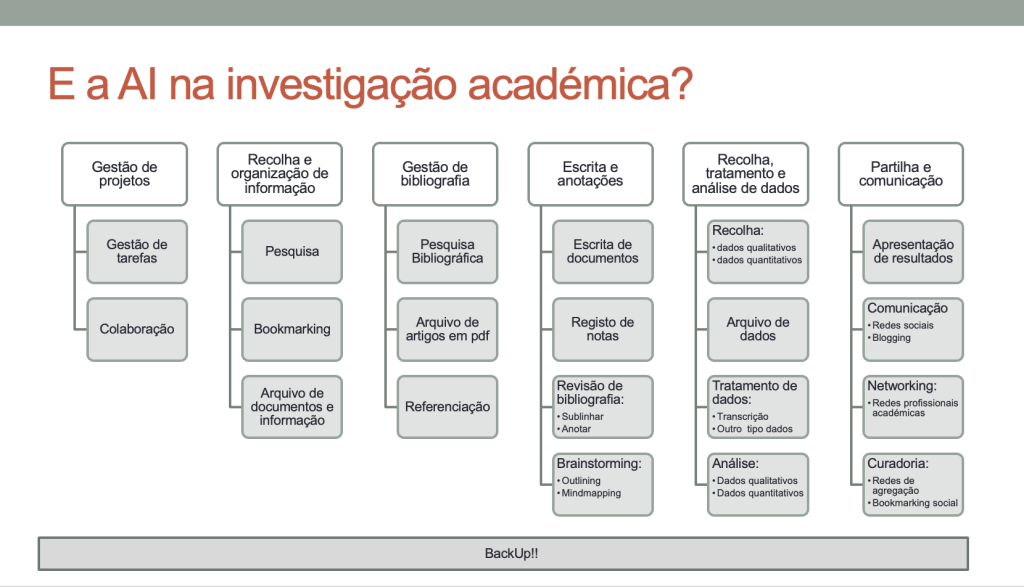

No âmbito desta aula, criei há uns anos um esquema que ilustra diferentes áreas em que as ferramentas digitais são utilizadas na investigação académica. O esquema é apenas ilustrativo e intencionalmente não exaustivo, sendo um dos exercícios propostos aos alunos pensar em outras áreas que não estão representadas. Ao preparar a aula deste ano, deparei-me com a necessidade de integrar uma reflexão sobre o uso de IA na investigação. Em vez de expandir o esquema identificando novas funcionalidades e áreas de aplicação, limitei-me a apresentar o esquema desta forma:

O motivo é simples: os sistemas e aplicações da IA não se restringem a funcionalidades ou áreas específicas, estão em crescente expansão e são pervasivos a todas as ferramentas e etapas da investigação científica aqui representadas. Podem estar ancorados em ferramentas direcionadas para o público geral, como o ChatGPT, ou ser incorporados em novas ferramentas concebidas para a investigação, como Scite.ai, Scholarcy, Paperpal, ResearchRabbit, entre outras. Além disso estão cada vez mais presentes nas ferramentas que usamos no nosso dia a dia. É o caso, por exemplo, dos processadores de texto que cada vez mais integram funcionalidades de AI para sugerir formatações, textos ou outros tipos de conteúdos, bem como das ferramentas de análise qualitativa como o MaxQDA, Nvivo e Atlas.ti, que agora incluem funcionalidades de IA que prometem facilitar a identificação de padrões em textos ou imagens.

Um Framework para o Estudo das Consequências Tecnológicas na Investigação

Paralelamente, ao longo deste tempo também tenho acompanhado o trabalho de Trena Paulus e Jessica Lester sobre o uso de ferramentas digitais na investigação. Num artigo recente, as autoras propõem o que definem como “a reflexivity framework for technological consequences” (2023). Neste artigo, enfatizam a importância de se pensar a relação entre a tecnologia e a investigação qualitativa numa abordagem que não assente num determinismo tecnológico – que tende a ver os investigadores como elementos passivos, forçados a adaptarem-se às mudanças impostas pela inovação tecnológica (algo muito comum nos discursos sobre IA) –, mas que também ultrapasse uma visão instrumental dessa relação – que tende a considerar a tecnologia como neutra e passiva, mera ferramenta sob o controle dos investigadores.

Por contraponto, as autoras propõem refletir sobre a relação entre tecnologia e método enfatizando a importância de uma prática reflexiva que tenha em consideração as consequências, tanto positivas como negativas, da integração da tecnologia na investigação. Nas suas palavras:

“Proporcionar uma forma sistemática de documentar intencionalmente estes ‘efeitos sociais’, na medida que se tornam visíveis durante o processo de investigação, é um dos motivos para delinear um workflow digital de investigação que valorize a reflexividade e que explicitamente considere as consequências [tecnológicas] como uma parte intencional do processo metodológico” (tradução da autora, p. 3).

Neste processo, as autoras identificam quatro diferentes categorias de consequências relacionadas com a adoção de ferramentas e espaços digitais na investigação: “Como executamos os métodos”, “Design das tecnologias”, “Relacionamentos humanos”, “Produção de conhecimento e resultados”. Cada uma destas categorias surge, por sua vez, associada a diferentes tipos de reflexividade: reflexividade metodológica (como a escolha do método influencia, cria e restringe os tipos de conhecimento que podem ser concebidos), posicional (como a produção de conhecimento é influenciada pelas relações entre investigadores, participantes e comunidades de prática, bem como por redes técnicas e metodológicas), disciplinar (o modo como a área disciplinar determina o que é considerado um tema de investigação válido e conhecimento aceitável) e textual (como diferentes formas de escrita podem ser utilizadas para reproduzir formas de representações autênticas do conhecimento) (Whitaker e Atkinson, 2021).

Um aspeto que considero interessante neste framework é que este não foi especificamente concebido para enquadrar os sistemas de IA e as práticas algorítmicas que lhes estão associadas. Pelo contrário, foca-se de forma mais ampla nas questões teóricas e metodológicas relacionadas com as tecnologias digitais que utilizamos e os espaços digitais por onde navegamos no nosso trabalho de investigação. Permite assim uma reflexão mais abrangente sobre estas questões, evitando o risco, apontado por Suchman (2023), de ‘coisificar’ a IA. Ou seja, evita reforçar a noção, já prevalecente na sociedade, de uma IA autónoma, agencial e descontextualizada dos seus efeitos localizados e das suas socio-materialidades. De facto, ao centrar-se na articulação entre tecnologia e método, este framework permite-nos pensar de forma mais integrada nas consequências que estas “práticas algorítmicas baseadas na utilização intensiva de dados” trazem para a produção de conhecimento nas ciências sociais e na importância da reflexividade tecnológica na investigação.

Pelo Desenvolvimento de uma Abordagem Reflexiva ao Impacto da IA na Investigação

O objetivo deste texto não é apresentar soluções definitivas ou respostas para as questões levantadas. Pelo contrário, trata-se de uma reflexão muito inicial que tem como único propósito ajudar-nos a pensar de forma mais abrangente e intencional sobre as implicações associadas a estes processos.

Refletindo sobre o nosso papel enquanto investigadores e docentes, questiono-me, sobretudo, sobre que competências reflexivas temos de desenvolver para melhor enquadrar os novos desafios éticos e metodológicos com que nos iremos deparar na investigação académica. Esta abordagem nunca poderá ignorar questões especificas que emergem quando discutimos o tema. Importa, em particular, desenvolver uma literacia em IA que tenha em conta as suas dimensões técnicas, sociais, políticas e éticas, entre outras. Contudo, é necessário que esta literacia se conjugue com uma reflexão mais alargada sobre a natureza do conhecimento que os sistemas de IA estão a ajudar a construir, especialmente nas ciências sociais. Ou seja, que seja integrada numa abordagem reflexiva que tenha em conta dimensões metodológicas, posicionais e disciplinares que nos ajudem a tornar a nossa utilização da IA mais ética e transparente, mas também teoricamente mais ancorada.

Jussara Rowland é socióloga e investigadora de pós-doutoramento no ICS-ULisboa. Os seus interesses atuais centram-se em torno do uso de métodos participativos e criativos, o impacto dos media digitais nas sociedades contemporâneas e comunicação de Ciência.